Essence

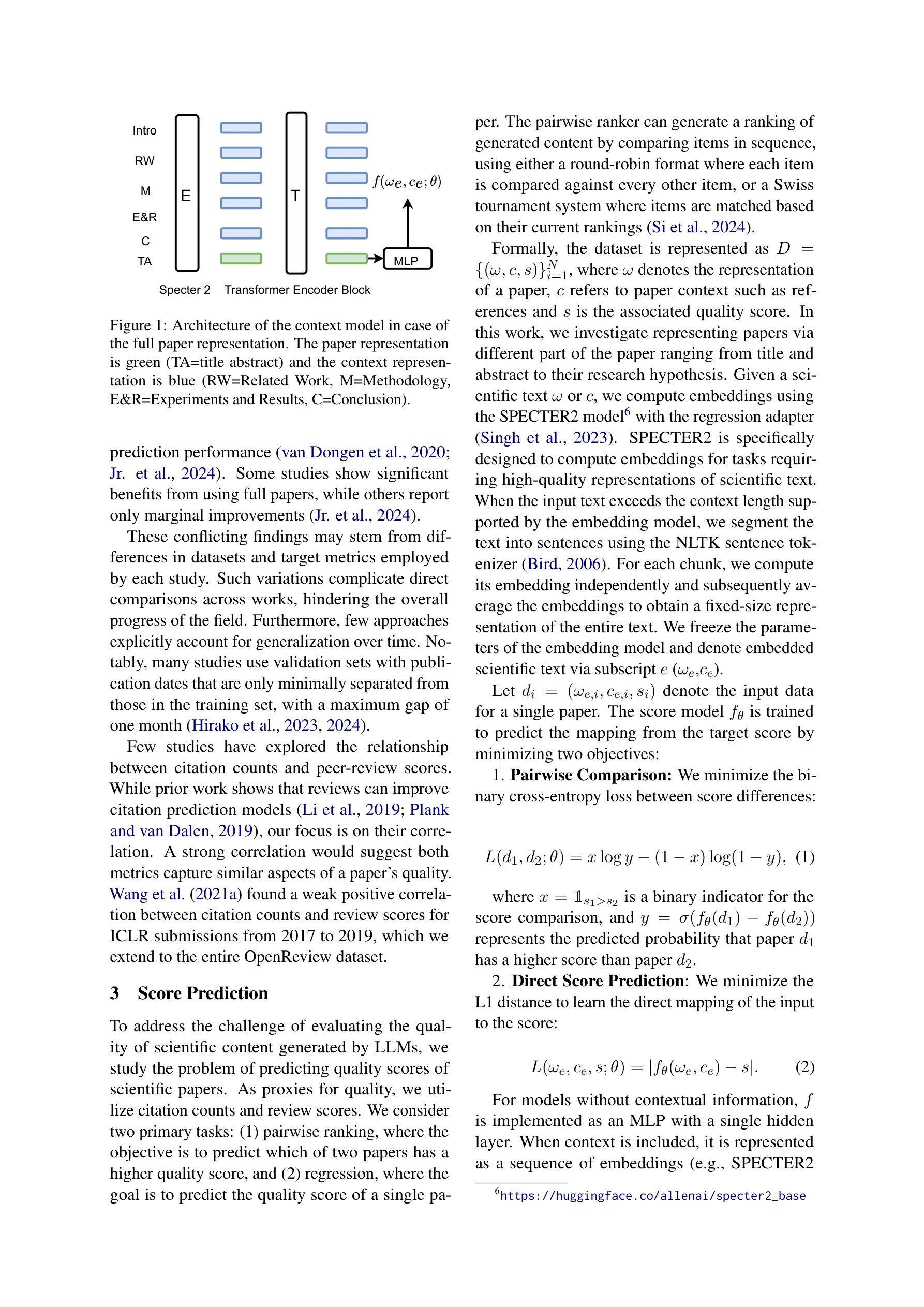

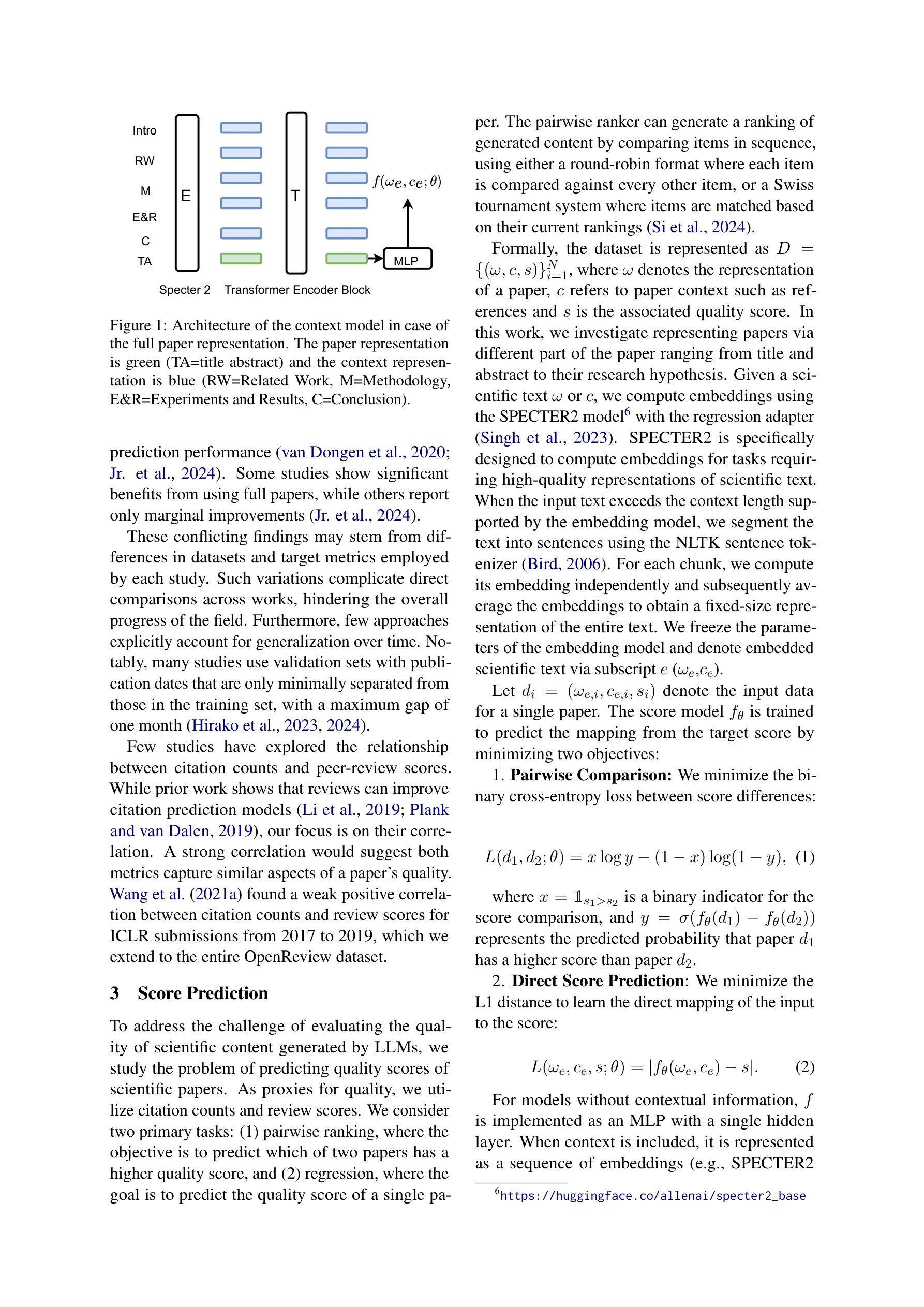

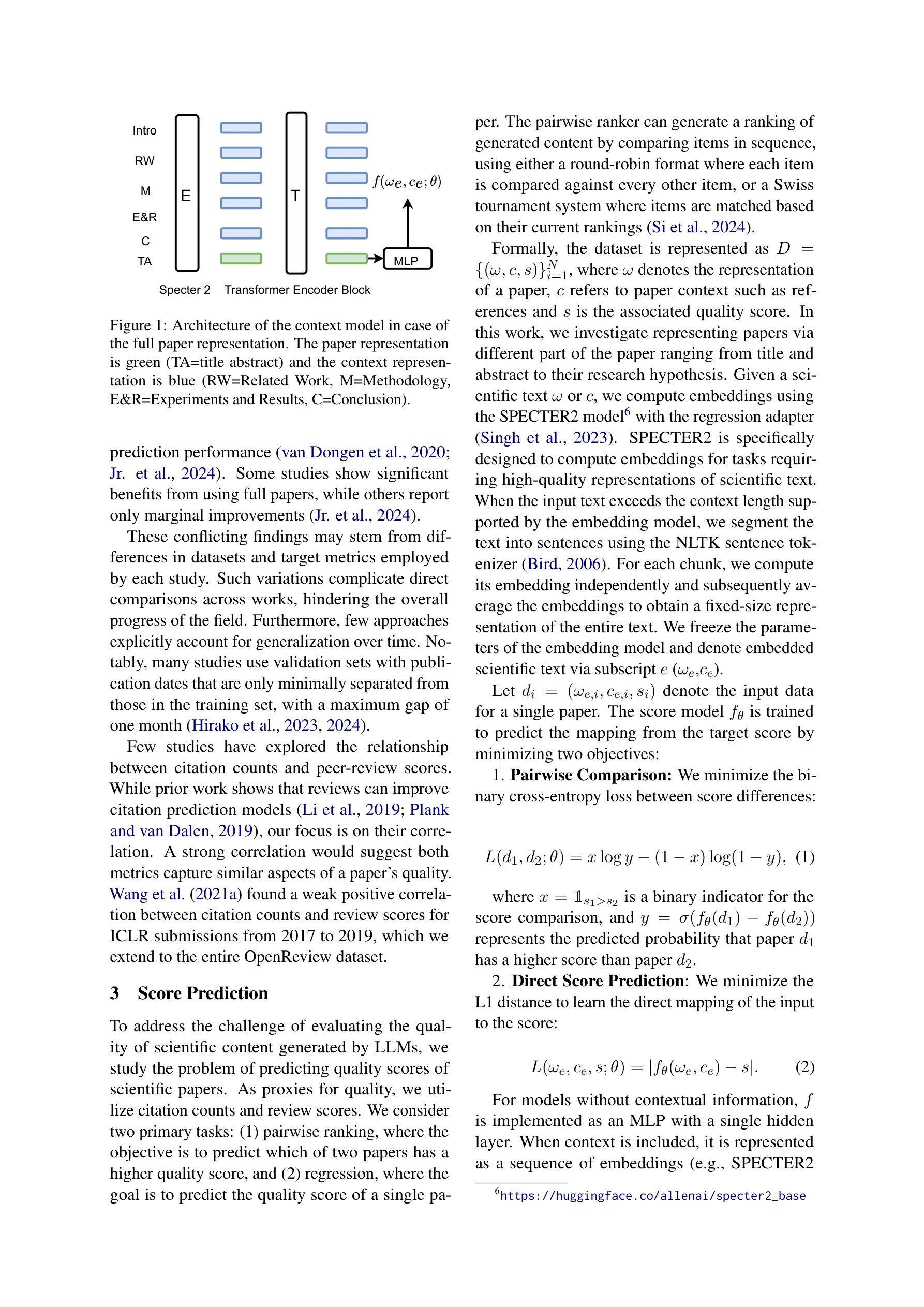

논문 표현을 위한 context model의 아키텍처: 제목-초록(초록색)과 관련 작업, 방법론, 실험 결과, 결론(파랑색)을 결합하여 처리

AI가 생성한 과학 논문의 품질 평가를 위해 인용 횟수 예측(Citation Count Prediction)과 리뷰 점수 예측(Review Score Prediction)을 자동 평가 지표로 제안하며, 단순 모델이 LLM 기반 검토자보다 인간 평가와 더 일치함을 입증한다.

저자: Niklas Hoepner, Leon Eshuijs, Dimitrios Alivanistos, Giacomo Zamprogno, Ilaria Tiddi | 날짜: 2025 | DOI: arXiv:2503.05712

논문 표현을 위한 context model의 아키텍처: 제목-초록(초록색)과 관련 작업, 방법론, 실험 결과, 결론(파랑색)을 결합하여 처리

AI가 생성한 과학 논문의 품질 평가를 위해 인용 횟수 예측(Citation Count Prediction)과 리뷰 점수 예측(Review Score Prediction)을 자동 평가 지표로 제안하며, 단순 모델이 LLM 기반 검토자보다 인간 평가와 더 일치함을 입증한다.

다양한 조건에서의 Pearson 상관계수 히트맵: 리뷰 점수와 인용 횟수의 관계

모델 아키텍처: SPECTER2 embedding을 이용한 문맥 정보 통합

총평: 이 논문은 AI 생성 과학 콘텐츠 평가의 중요한 문제에 대해 실용적이고 신뢰할 수 있는 자동 지표를 제안하며 대규모 표준화 데이터셋을 제공함으로써 학계에 유의미한 기여를 하고 있으나, 인간 수준 성능 달성과 모델 복잡도 향상 여지가 남아있다.