Essence

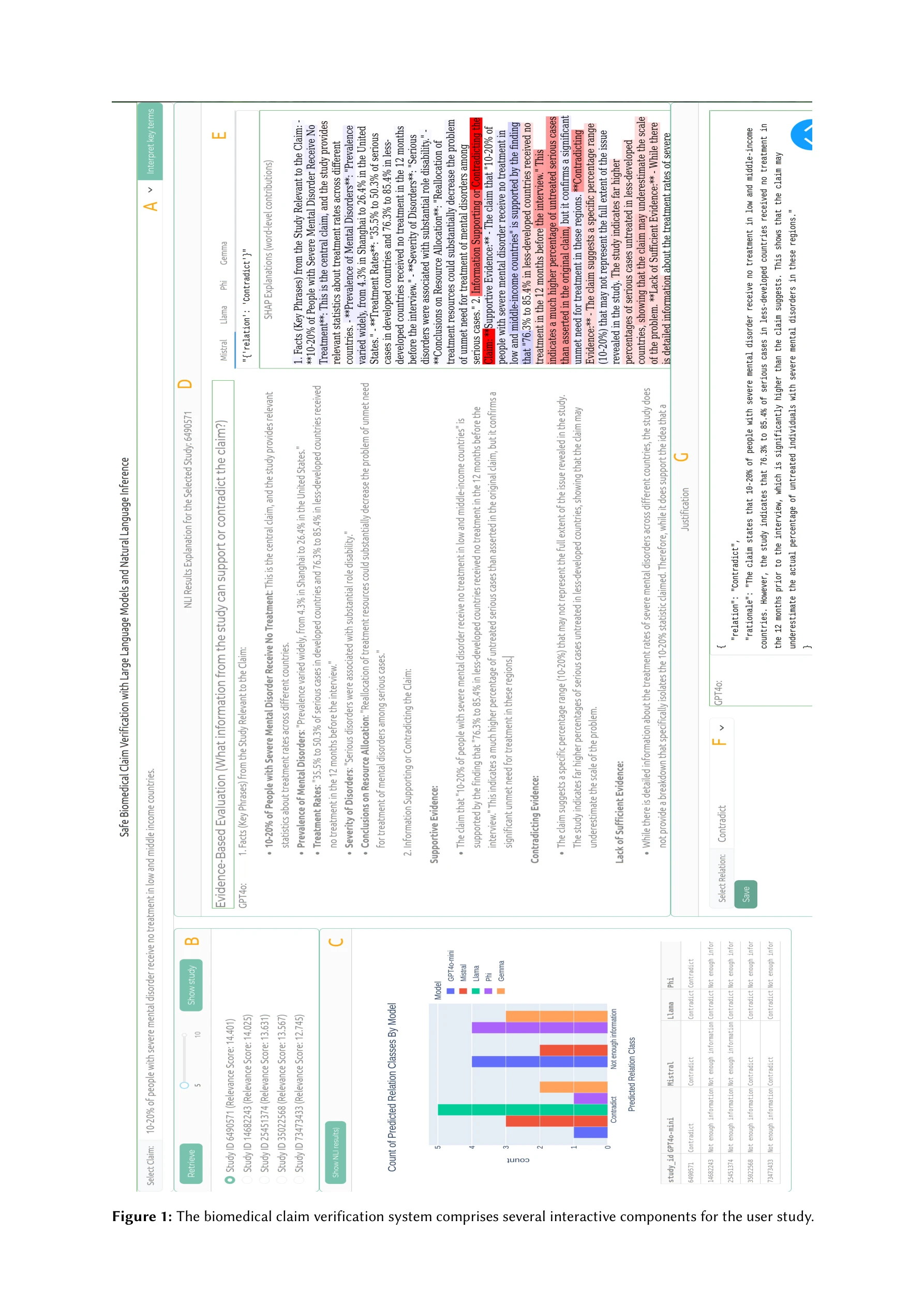

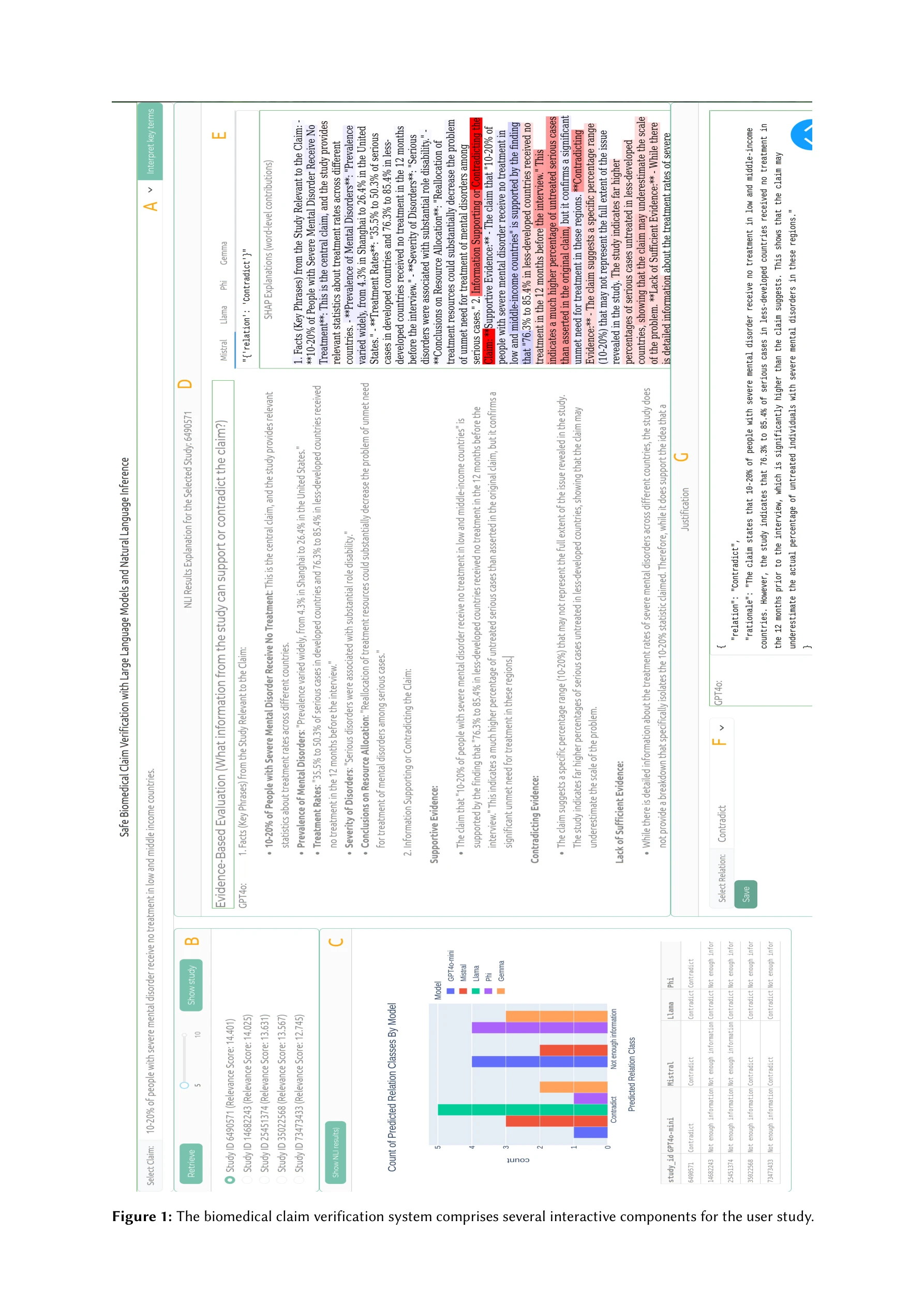

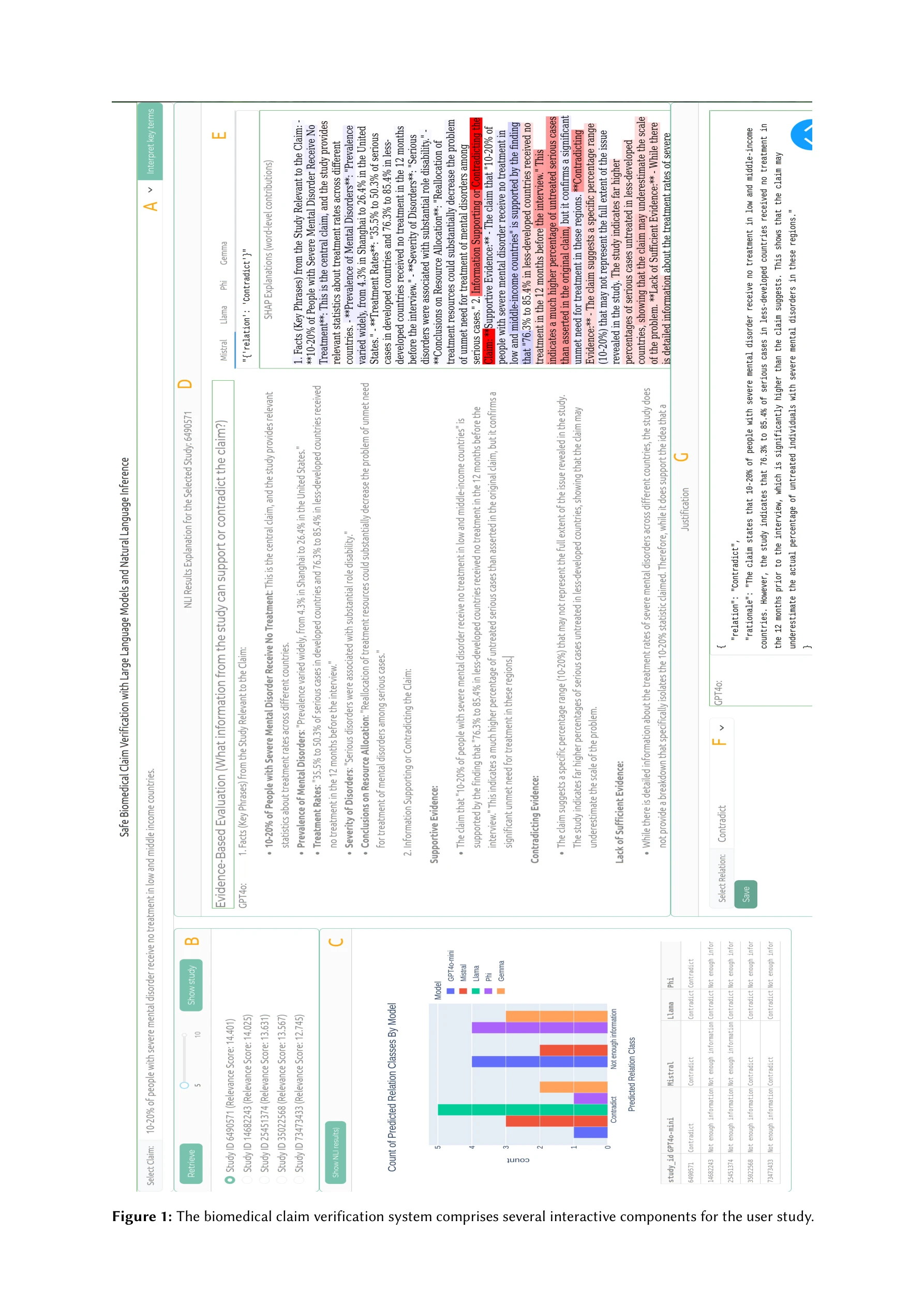

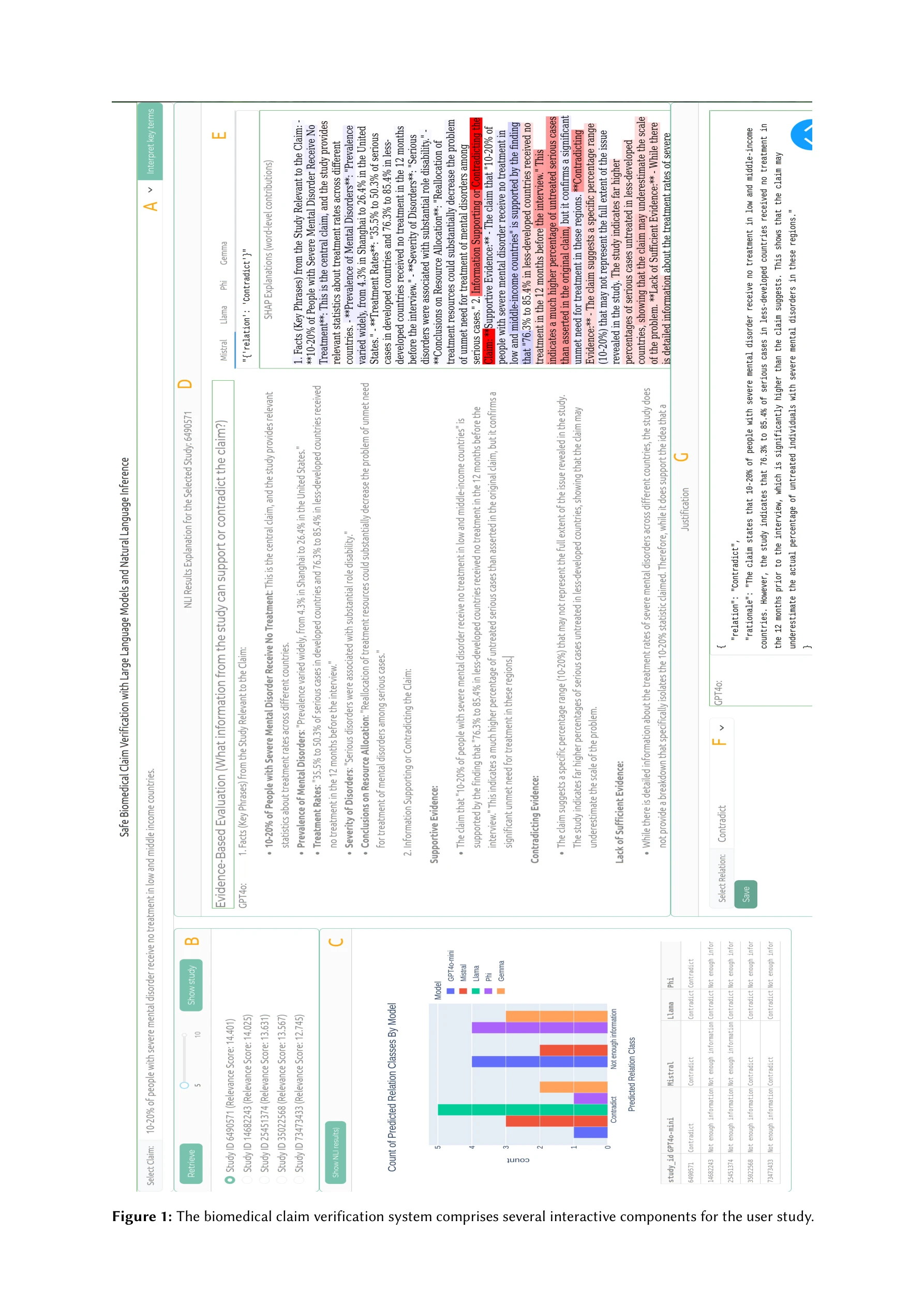

그림 1: 생의학 주장 검증 시스템의 대화형 컴포넌트들

대규모 언어 모델(LLM)과 SHAP 설명가능성을 결합하여 의료 주장 검증의 투명성을 높이는 대화형 시스템을 제시한다. 사용자는 과학 문헌에서 관련 연구를 검색하고, CoENLI 프레임워크를 통해 LLM의 추론 과정을 검토하며, SHAP 값으로 단어 수준의 기여도를 파악할 수 있다.

저자: Siting Liang, Daniel Sonntag | 날짜: 2025 | DOI: arXiv:2502.21014

그림 1: 생의학 주장 검증 시스템의 대화형 컴포넌트들

대규모 언어 모델(LLM)과 SHAP 설명가능성을 결합하여 의료 주장 검증의 투명성을 높이는 대화형 시스템을 제시한다. 사용자는 과학 문헌에서 관련 연구를 검색하고, CoENLI 프레임워크를 통해 LLM의 추론 과정을 검토하며, SHAP 값으로 단어 수준의 기여도를 파악할 수 있다.

그림 2: 증거 분석과 SHAP 기반 설명의 이중층 설명가능성

그림 4: CoENLI 프레임워크의 3단계 추론 과정

시스템 워크플로우:

기술적 구성요소:

총평: 생의학 주장 검증의 투명성을 위해 CoENLI와 SHAP을 결합한 대화형 시스템은 실질적 가치 있는 제안이나, 논문이 미완성된 상태(평가 섹션 절반만 기재, 사용자 연구 결과 누락)로 과학적 검증이 불충분하다. 후속 완전판 논문 발표 시 상당히 향상될 것으로 예상된다.