Essence

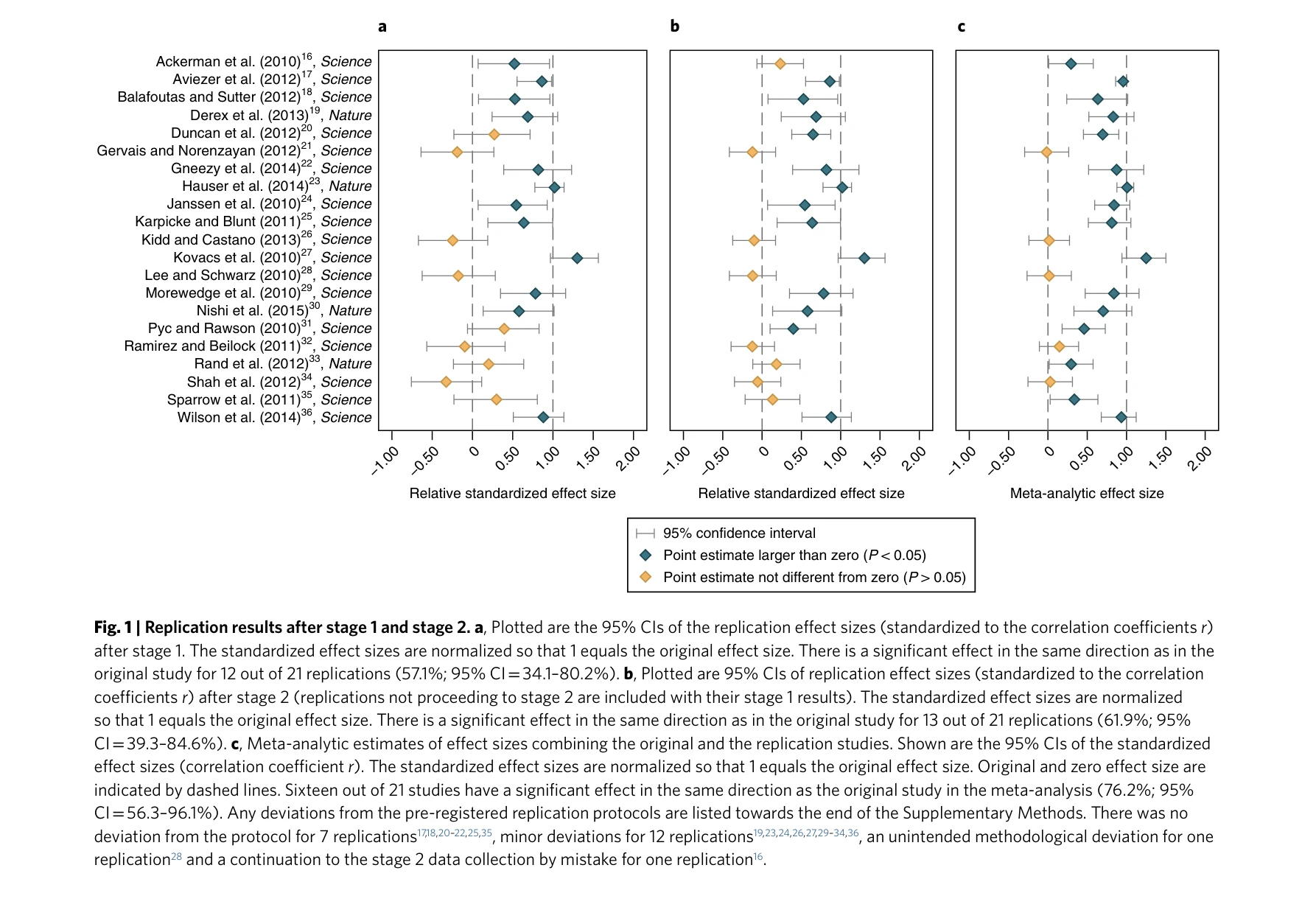

Fig. 1 | Replication results after stage 1 and stage 2. a, Plotted are the 95% CIs of the replication effect sizes (stan

2010-2015년 Nature와 Science에 발표된 사회과학 실험 21개를 체계적으로 재현한 결과, 62%만이 원래 방향의 유의미한 효과를 보였으며 평균 효과크기는 원래의 50% 수준임을 보고한다.

저자: Colin F. Camerer, Anna Dreber, Felix Holzmeister, Teck-Hua Ho, Jürgen Huber, Magnus Johannesson, Michael Kirchler, Gideon Nave, Brian A. Nosek, Thomas Pfeiffer, Adam Altmejd, Nick Buttrick, Taizan Chan, Yiling Chen, Eskil Forsell, Anup Gampa, Emma Heikensten, Lily Hummer, Taisuke Imai, Siri Isaksson, Dylan Manfredi, Julia Rose, Eric-Jan Wagenmakers, Hang Wu | 날짜: 2018 | DOI: 10.1038/s41562-018-0399-z

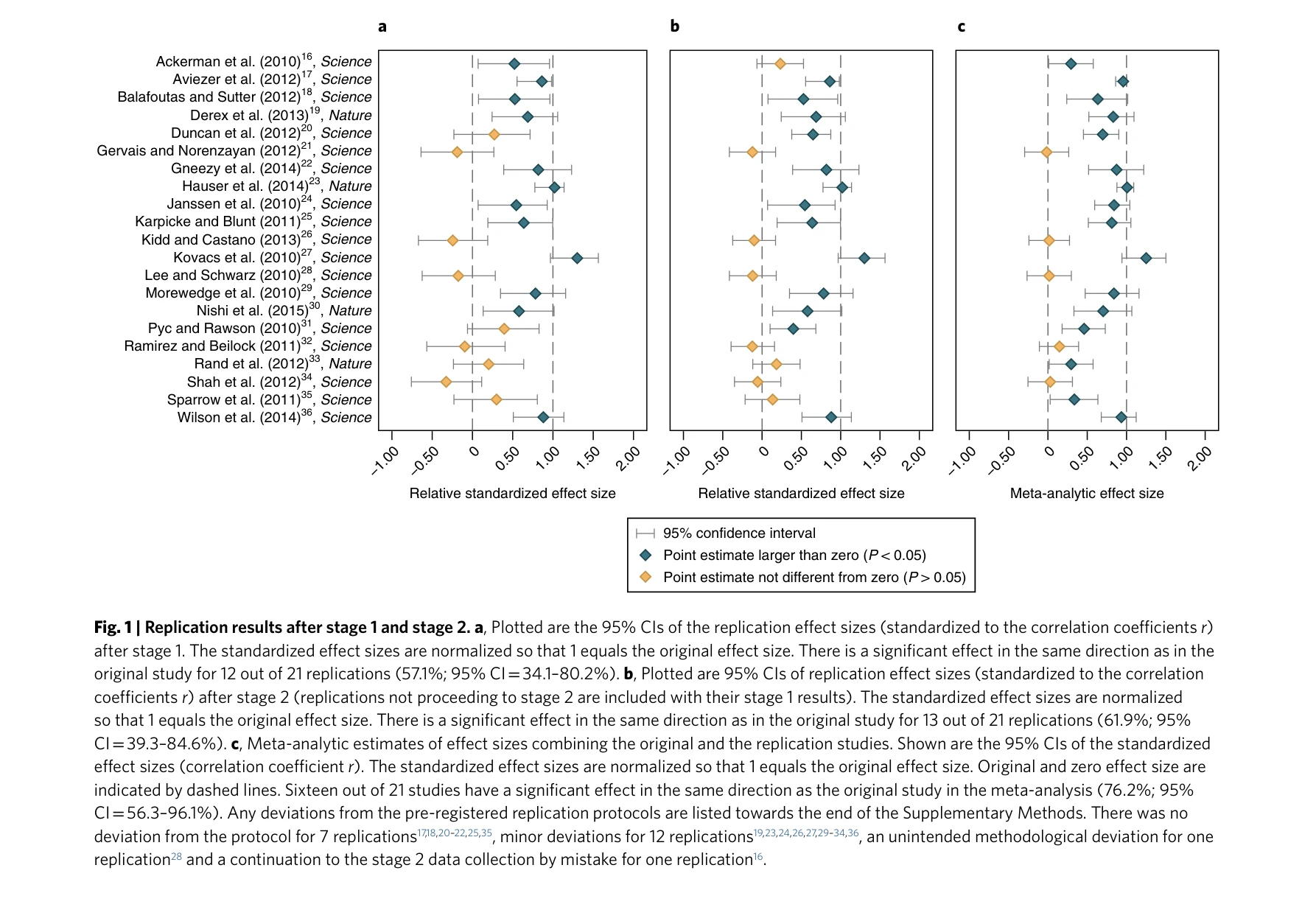

Fig. 1 | Replication results after stage 1 and stage 2. a, Plotted are the 95% CIs of the replication effect sizes (stan

2010-2015년 Nature와 Science에 발표된 사회과학 실험 21개를 체계적으로 재현한 결과, 62%만이 원래 방향의 유의미한 효과를 보였으며 평균 효과크기는 원래의 50% 수준임을 보고한다.

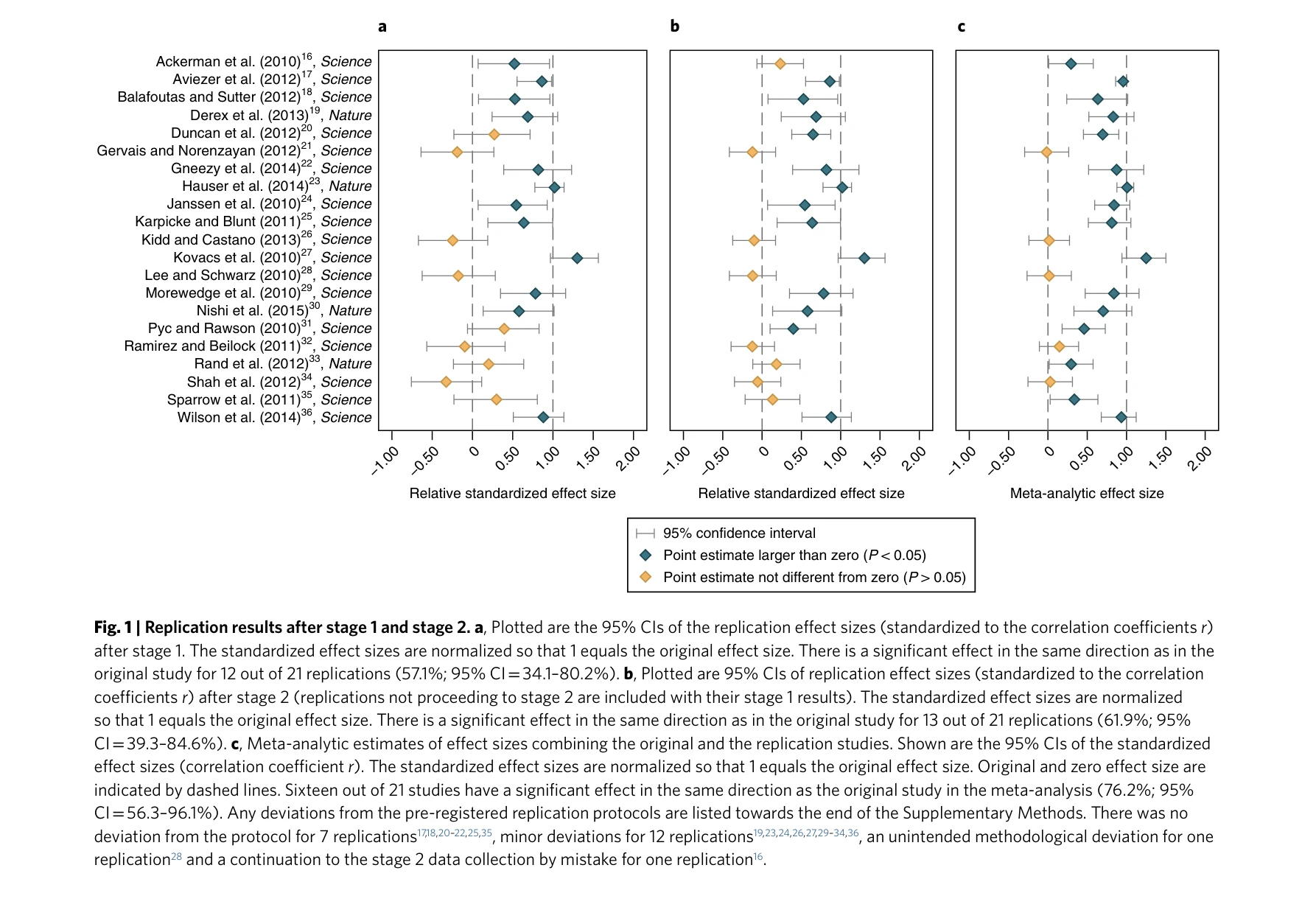

Fig. 1 | Replication results after stage 1 and stage 2. a, Plotted are the 95% CIs of the replication effect sizes (stan

총평: 이 연구는 최고 권위 저널의 사회과학 실험이 예상보다 낮은 재현율(62%)과 감소된 효과크기(50%)를 보임을 체계적으로 입증하여 과학 출판과 방법론의 신뢰성 문제를 중요하게 조명했으며, 사전 등록과 투명한 재현 프로토콜이 과학 커뮤니티 표준이 되도록 기여한 중요한 메타과학 연구이다.